Era il 2021 quando assistemmo alla prima vera crisi dei chip in epoca moderna, scaturita da una sfortunata congiunzione di concause: la pandemia, che tenne chiusi gli stabilimenti di produzione e che allo stesso tempo fece schizzare la domanda di prodotti elettronici, i problemi globali di approvvigionamento, il conflitto fra Russia e Ucraina, l’instabilità economica e così via. Di quella crisi vi parlai in un video-editoriale, ma da allora la situazione si è progressivamente ristabilizzata e adesso siamo passati dall’avere pochi chip ad averne troppi perché le vendite di smartphone, tablet e PC sono in pesante calo. Quello che invece non sta calando, anzi, è l’impennata che sta vivendo il mondo dell’intelligenza artificiale, la cui crescente diffusione sta però portando a una nuova crisi dei semiconduttori.

La crisi dei semiconduttori torna a farsi sentire, e questa volta è per via dell’intelligenza artificiale

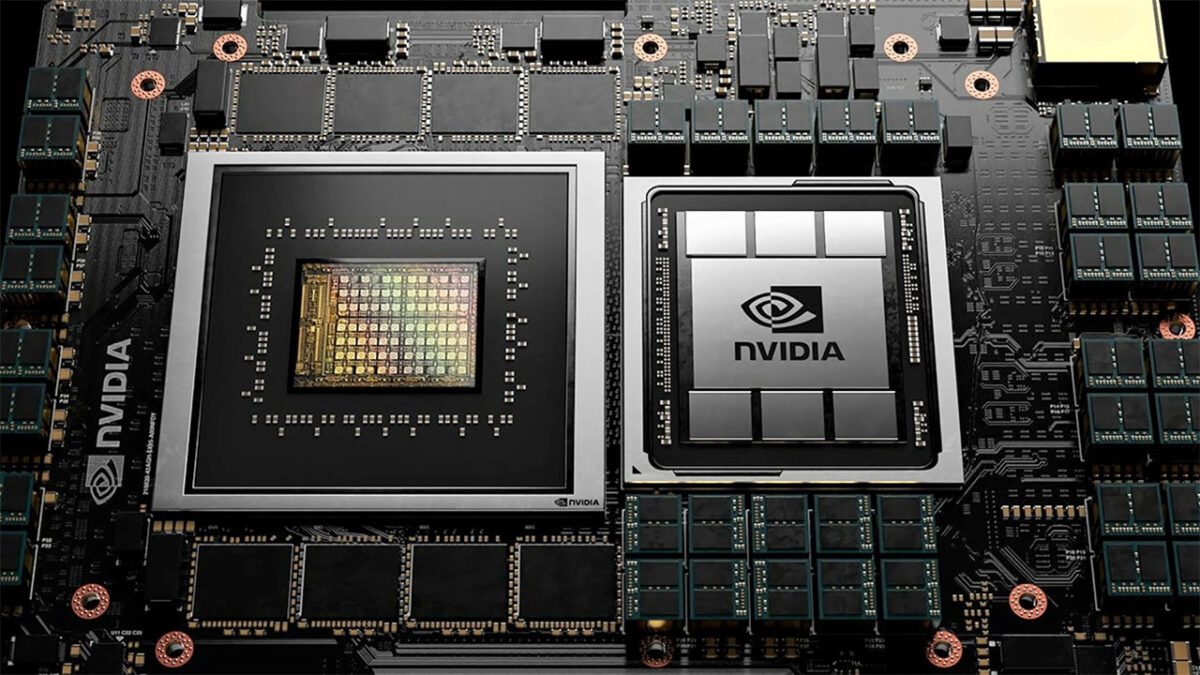

Se finora si è parlato di scarsità di microchip in merito a elettronica di consumo, elettrodomestici e automobili, l’esplosione dell’intelligenza artificiale ha portato sotto i riflettori nuovi problemi per l’industria dei semiconduttori. Data la complessità tecnica necessaria per alimentare tecnologie come GPT-4 e annessi ChatGPT e Bing, Google Bard, Midjourney, DALL-E e così via, sono pochissime le aziende in grado di soddisfare le richieste dei colossi tech che stanno costruendo le proprie piattaforme IA. Attualmente è NVIDIA il chipmaker di riferimento per l’industria globale, e non a casa gli USA l’hanno bloccata dal commerciare con la Cina. Da tempo, il chipmaker statunitense ha puntato con prepotenza al mercato IA; fra i suoi prodotti di punta ci sono le GPU NVIDIA A100 e H100, con oltre 28.000 sue unità che alimentano la piattaforma ChatGPT, e si stima che Google avrebbe bisogno di diversi milioni di queste schede grafiche per trasformare il suo motore di ricerca.

Tutti stanno comprando le GPU IA di NVIDIA: OpenAI, Microsoft, Google, Amazon, Baidu, una lista destinata ad aumentare quando ogni compagnia deciderà di avere una propria piattaforma d’intelligenza artificiale. E si sa, quando un mercato è in mano soltanto a un produttore, il rischio di collo di bottiglia non è questione di “se” ma di “quando”. E il “quando” sembra essere arrivato, perché dall’Asia arrivano notizie sui problemi di produzione di NVIDIA, che sarebbe subissata di ordini da parte dei suoi clienti e non starebbe riuscendo ad accontentarli. Anche perché ricordiamo che NVIDIA è un chipmaker fabless, e questo significa che ingegnerizza i chip che però vengono poi prodotti unicamente da TSMC, e quindi abbiamo due colli di bottiglia: nello sviluppo e nella produzione.

Per ovviare al problema, NVIDIA ha annunciato una partnership con ServiceNow per creare funzioni IA generative che automatizzino i processi lavorativi di NVIDIA e accelerino le tempistiche di produzione, il ché torna a far parlare dei rischi dell’automazione per il tessuto lavorativo, con IBM che prevede migliaia di posti persi in favore dell’IA. Lato produttivo, GPU come le NVIDIA A100 e H100 sono realizzate sui nodi a 7 e 4 nm di TSMC, e l’intensificarsi della loro produzione potrebbe ripercuotersi su altri settori, in primis quello del gaming, con NVIDIA che potrebbe preferire dare priorità alle GPU IA piuttosto che a quelle per console e PC da gaming, che hanno già pesantemente sofferto la succitata crisi dei semiconduttori. Il motivo è presto detto: questo boom sta significando sia carenza di scorte che un rincaro dei prezzi. Ne sta soffrendo soprattutto la Cina, dove le GPU NVIDIA A800 e H800, versioni modificate di A100 e H100 ad hoc a causa del ban americano, vengono vendute al 40% in più rispetto al prezzo di listino fino a circa 36.500$ l’una per l’A800, costringendo compagnie a ripiegare sulle più datate GPU NVIDIA V100 del 2018, ancora ferme alla prima generazione Tensor Core ma per ben 10.000$.

⭐️ Scopri le migliori offerte online grazie al nostro canale Telegram esclusivo.